우리가 아는 거대 언어 모델들을 경량화한 버전들을(llama, deepseek 등등) ollama를 사용해서 로컬 시스템에서 사용할 수 있다.

오늘은 우선 설치 방법이랑 사용 명령어를 좀 정리해보려고 한다.

설치

설치 방법은 그냥 공식 홈페이지 가서 다운 받으면 된다.

Ollama

Get up and running with large language models.

ollama.com

관련 명령어

Ollama 설치 이후 터미널 창에 ollama를 쳐보자

ollama 관련 명령어를 소개하고 있다. 각 명령어의 기능은 뭐 어려운 영어가 아니니깐 대충 유추가 된다.

그럼 한번 모델을 돌려보자 먼저 ollama list를 쳐서 현재 설치해둔 모델이 있는지 살펴보자

내가 며칠전에 써본다고 다운받았던 llama3 8b 랑 한국어로 튜닝된 llama3.1 8b들이 존재한다. 여기서 한번 llama3 8b 모델을 지우려면 그냥 ollama rm [NAME]을 치면 지워진다.

지워졌으면 이번에는 모델을 다운 받고 돌려보자. 최근에 한번 세상을 떠들썩하게 했던 deepseek 모델을 사용해보자.

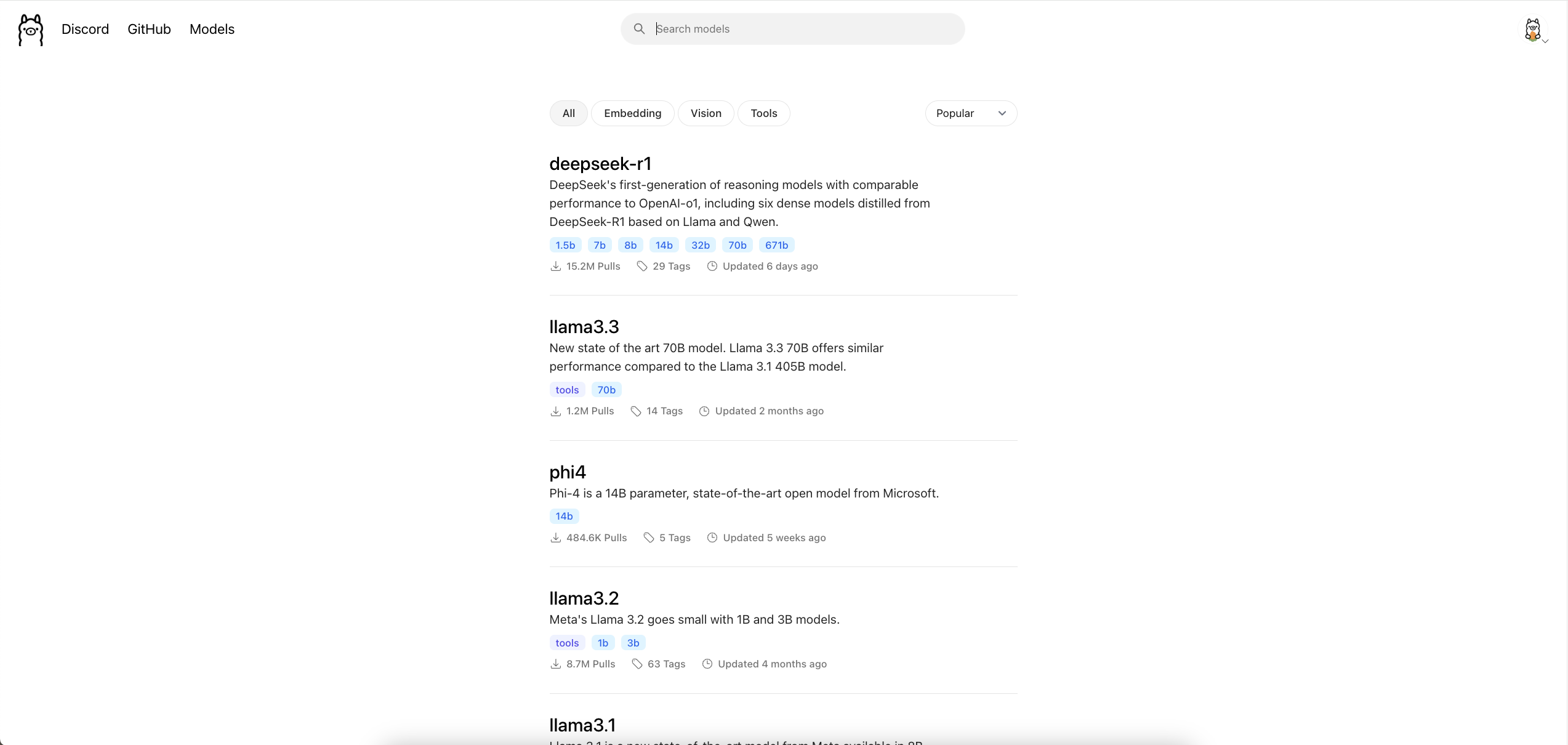

ollama 홈페이지에서 좌측 상단에 Models라는 메뉴를 누르면 다음과 같은 화면이 나타난다.

뭐 마침 deepseek-r1이 위에 있긴한데 다른 모델을 찾을거면 검색해도 된다.

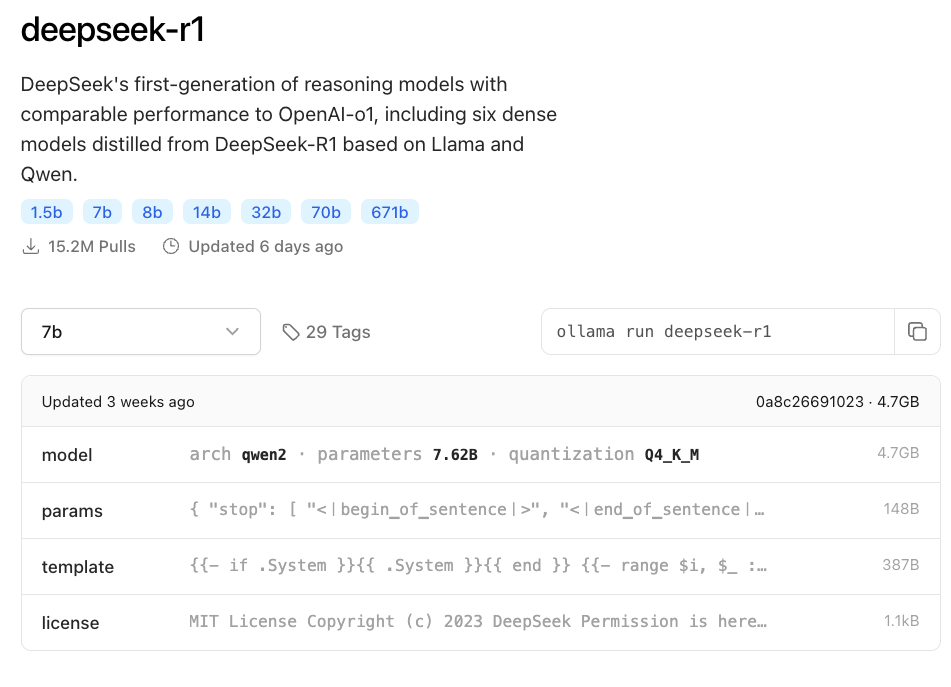

아무튼 눌러보면

어떤 모델 크기를 사용할지 그리고 어떻게 구동하는지에 대한 가이드가 나와있다. 8b모델로 변경하고 ollama run deepseek-r1:8b 을 사용해서 한번 구동해보자

잘 구동되었다 취소하려면 그냥 /bye 치면 된다.

잘 구동된다 우선은 터미널로만 실행시키는 법에 대해서 알아봤고 먼가 얘를 써먹어보려면 결국 어떤 프로세스와 와리가리가 되어야할 것 같은데 다음 게시물에 한번 파이썬 ollama 모듈을 통해서 한번 간단한 질의응답 서버를 만들어봐야겠다.

'개발 관련 공부' 카테고리의 다른 글

| Containerlab 개요 (0) | 2025.12.11 |

|---|---|

| MCP Tutorial (0) | 2025.04.11 |

| mcp-image-reader 설치하며 겪었던 소소한 문제 (1) | 2025.04.03 |